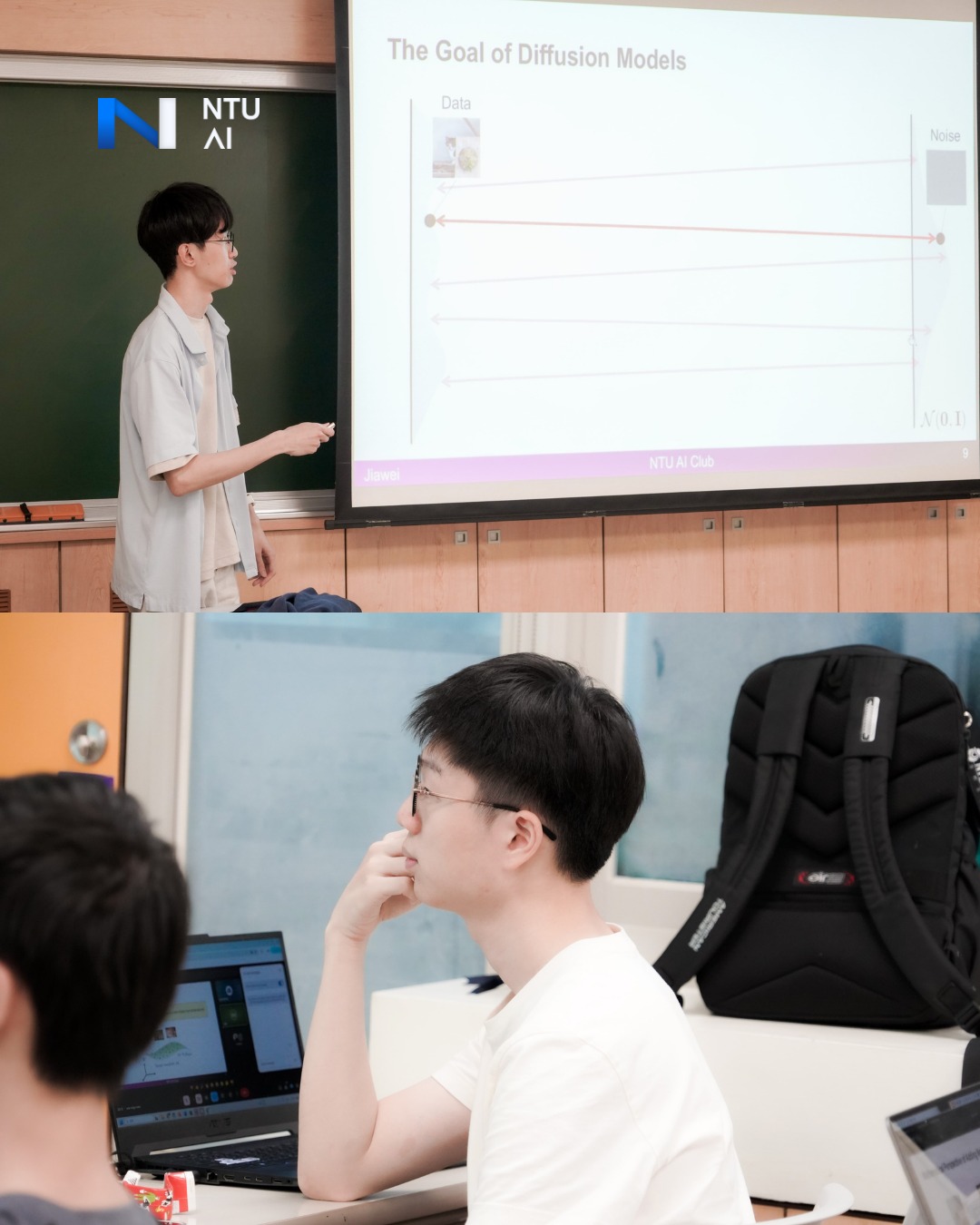

這次社團邀請到了國立臺灣大學資訊工程學系的博士候選人 廖家緯學長,分享現在生成模型領域的熱門技術: #Diffusion Models(#擴散模型)的原理與最新研究。

廖學長從生成原理出發,說明如何透過順向與逆向過程,讓模型學會在「影像」與「雜訊」之間建構一座轉換的橋樑。在 Forward Process 中,模型將清晰影像逐步加入雜訊,最終轉為純高斯雜訊;而在 Reverse Process,則是訓練模型一步步去除雜訊,重建出原始影像。訓練目標也很直觀,就是最小化預測雜訊與實際雜訊之間的差距,常見的作法是使用均方誤差(#MSE)損失函數。

為了解決高解析度影像帶來的龐大計算負擔,Latent Diffusion Model (LDM) 的出現成為突破口,也就是我們熟知的 Stable Diffusion。LDM 透過預訓練的 #VAE(自動編碼器)將影像壓縮至潛在空間中進行擴散,大幅降低計算成本與提升效率。

廖學長也特別強調了「可控性」在擴散模型應用上的重要性。早期採用 Classifier Guidance (CG) 搭配額外訓練的分類器控制輸出內容,而後來發展出更靈活實用的 Classifier-Free Guidance (CFG),讓模型同時學會處理有條件與無條件輸入,並透過一個可調整的引導強度參數 gamma 精準控制生成結果。值得注意的是,gamma 若設定過高,可能會導致生成結果失真,這也是需要細心調整的關鍵。

接著介紹的 #ControlNet 更是讓可控性推進到新的高度。它能夠根據草圖、輪廓或骨架資訊等提示,讓模型生成更加符合細節需求的影像。這是透過凍結原始模型參數,只訓練少量新增的「零卷積層(zero convolution layers)」達成,常見的應用如虛擬試衣,不用真的試穿就可以知道這件衣服適不適合你!

除了理論與架構,廖學長也展示了他與研究團隊的兩項創新應用:

DiffQRCoder:美化 QR Code 生成技術 - 傳統美化 QR Code 常面臨掃描失敗的問題。DiffQRCoder 則設計了一個可微分的損失函數來同時保留結構與美感,並結合 Scanning Robust Perceptual Guidance (SRPG),實現具備實用性與藝術感的 QR Code,甚至吸引到企業主動聯繫合作!

AtkPDM:針對 Diffusion Models 的 Evasion Attack 技術 - 為了防止生成模型被惡意利用,AtkPDM 在影像中加入人眼難以察覺的「對抗性擾動」,讓影像在進入擴散模型處理後產生失真,進而保護原始內容,對於深偽技術的防護提供了新的思路。

在本次讀書會中,廖學長說明了 Diffusion Models 基本概念到進階應用,涵蓋了 LDM、CFG、ControlNet 等多項核心技術,理解生成模型的原理,也帶來實際落地的創新案例。廖學長也與現場參與的社員討論未來值得探索的議題,例如:gamma 引導強度的穩定範圍、與其他生成模型(如 Autoregressive model 自回歸模型)的結合與互補,值得各位深入探究!

活動照片